ヒューマンAIインタラクション研究室

新たなインタラクションの地平:ヒューマンAIコラボレーティブインテリジェンスに向けて

教員

-

教授:SAKTI Sakriani

-

准教授:大内 啓樹

-

助教:MEHMOOD Faisal

-

助教:ATMAJA Bagus Tris

|

ssakti@is.naist.jp hiroki.ouchi@is.naist.jp mehmood.faisal@naist.ac.jp bagus.tris@naist.ac.jp |

|

| 研究室のサイト | https://hai-lab.naist.jp/ |

研究を始めるのに必要な知識・能力

ヒューマンAIインタラクションの研究に情熱を持って取り組む学生を歓迎します。特に、出身学部を制限しません。数学やアルゴリズムに関する基礎知識、コンピュータプログラミング(Pythonなど)と機械学習の経験があり、英語でのコミュニケーションに興味を持っている方をお待ちしています。

研究室の指導方針

各学生は、修士論文/博士論文の研究プロジェクトを実行します。トピックは、ラボプロジェクトのテーマとともに学生の興味に基づいて決定されます。学生の能力を高めるために、以下を実施します。

- 1対1のミーティングによる集中的な議論。

- 研究の進捗状況とラボミーティングによるグループディスカッション。

- 研究実験の補助。

- 科学論文の執筆とプレゼンテーションのスキルを向上させるためのガイダンス。

この研究で身につく能力

学生は、最先端のヒューマンAIインタラクションに関する知識を習得し、研究プロジェクトを行なう経験を積むことができます。さらに、観察、システム開発、問題解決、技術論文の閲覧、科学的プレゼンテーションのスキルを身に付けることができます。また、企業へのインターン、あるいは、博士後期課程では海外のトップ研究機関への留学を行い、世界的に活躍する研究者を育成します。また、企業との共同研究を担当することで、社会で求められていることが何かについても学びます。

修了生の活躍の場

新しく設立された研究室ですので、卒業生はまだ多くありませんが、人間とAIのインタラクション分野は、NTT、NEC、Google、Facebookなどの大手企業を含む様々な業界から注目されています。将来、社会で活躍する機会が多くあると思います。

研究内容

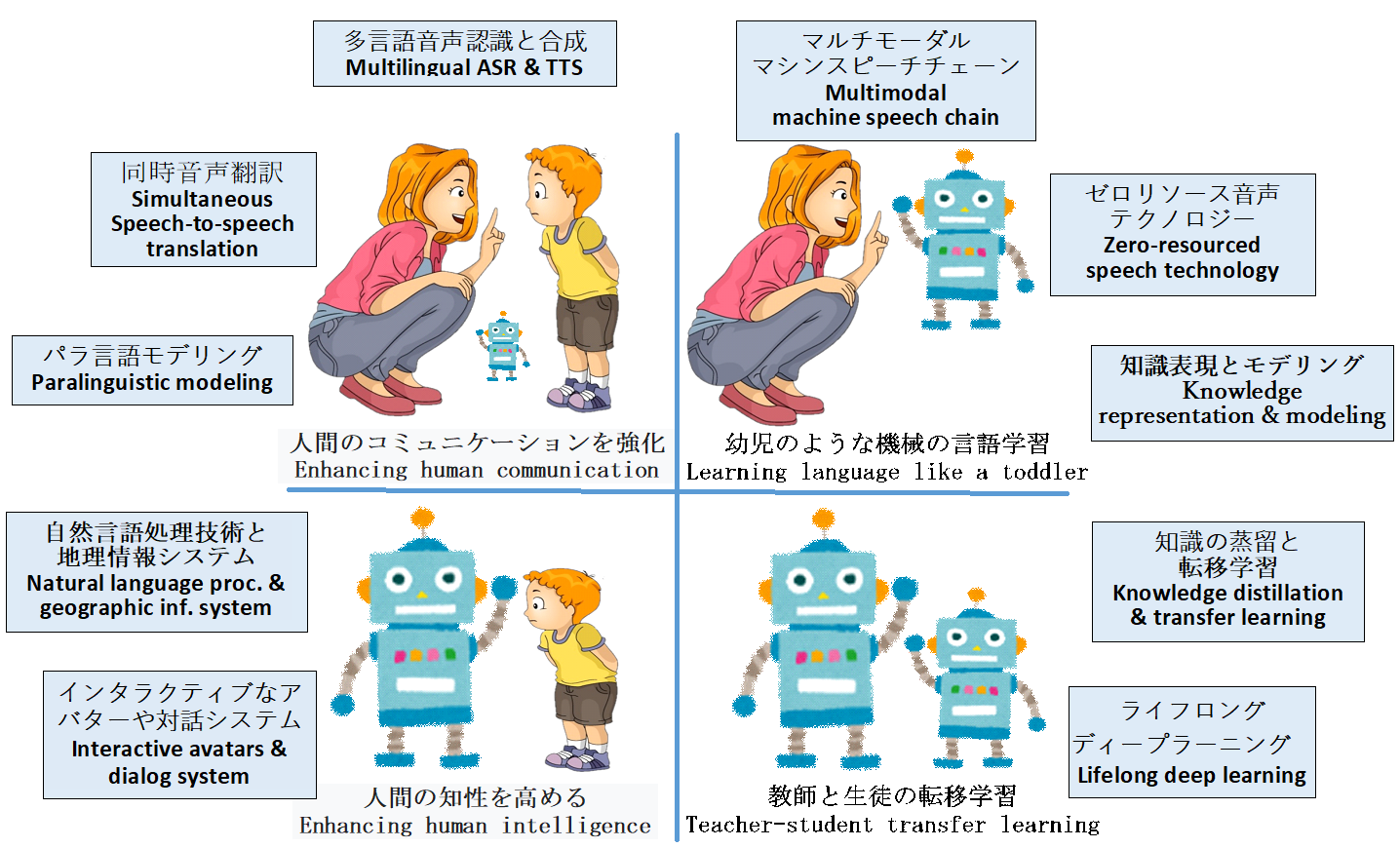

空間知能統合型言語AI

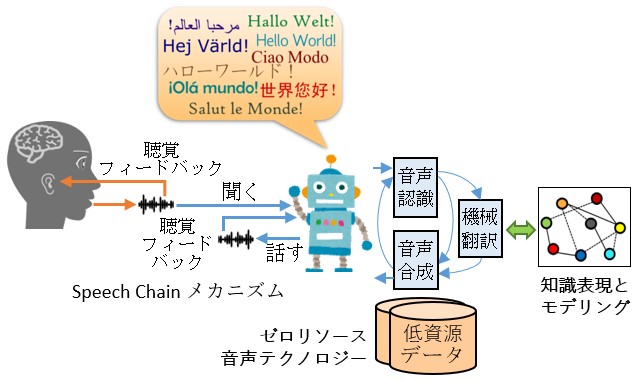

自然言語処理技術を基盤とするAIシステムの言語知能に着目し、その方法論を探究します。たとえば、リアルタイムの言語理解、コンテキストに敏感な言語生成、および音声から音声への直接翻訳をカバーする人間のような同時音声翻訳が含まれます。また、AIシステムの空間知能についても探究します。たとえば、地理空間に関する分析や、自然言語処理技術と地理情報システム(Geographic Information Systems)の統合などがあります。これにより、言語だけでなく、実世界の地理空間についても高度に思考できるAIシステムの実現を目指します。

多様な形のインタラクティブAI

人間と機械の相互作用を高めるためのさまざまな技術を探究します。たとえば、インタラクティブなアバターや遠隔臨場感システム、知的な対話システム、ビューシェアリングシステムの開発、VR / AR技術の統合などが含まれます。新しいインターフェースとモダリティの探求により人間の認知と機械学習能力についての深い理解に貢献します。

表現学習と発達型AI

研究領域としては、人間のような学習プロセスに着想を得たディープラーニング技術にも焦点を当てます。これには、乳幼児の学習のエミュレーションとしてのゼロ資源音声技術や、教師なし/教師あり学習、および低計算資源のためのモデル・パラメータ削減、継続学習、自己認識及び自己改善メカニズムが含まれます。また、性能改善のための転移学習と知識蒸留の手法も探求します。このように多様なデータ資源と言語を効率的に処理するための多様なモダリティと多言語の能力を強調した汎用的な情報表現のモデリングに取り組みます。

研究設備

計算インフラストラクチャ(CPUs、GPUs、マルチコアのクラスタマシン)

研究業績・共同研究・社会活動・外部資金など

国内外において多数の対外発表を行いました。競争的資金は、科研費(基盤SとB)といった予算を獲得しています。共同研究は、民間企業オンキヨーといった予算を獲得しています。また、NICT研究所と理研AIPの研究プロジェクトにも参画し、他大学の研究者(インドネシア、ベトナム, など)とも積極的に共同研究を実施しています。